Las redes y plataformas en Internet están siendo cada vez más influidas por sistemas automatizados como bots y herramientas de inteligencia artificial (IA), lo que plantea desafíos considerables en materia de confianza, seguridad y transparencia digital, coinciden varios especialistas en tecnología y ciberseguridad.

El fenómeno se ha acelerado en los últimos años, con algoritmos y agentes automatizados que participan activamente en actividades cotidianas en línea, desde la generación de contenido hasta la manipulación de precios o la evaluación de productos y servicios. Estos sistemas, que operan sin intervención humana directa, han empezado a dominar aspectos fundamentales de la vida digital de millones de usuarios, generando incertidumbre sobre la autenticidad de la información y las interacciones en la red.

Especialistas destacan que la proliferación de bots —programas automatizados que simulan comportamiento humano— dificulta la diferenciación entre usuarios reales y sistemas automatizados. Esta situación afecta no solo la experiencia del usuario, sino también la seguridad en transacciones, la validez de reseñas y la percepción de confianza en plataformas de comercio y comunicación virtual.

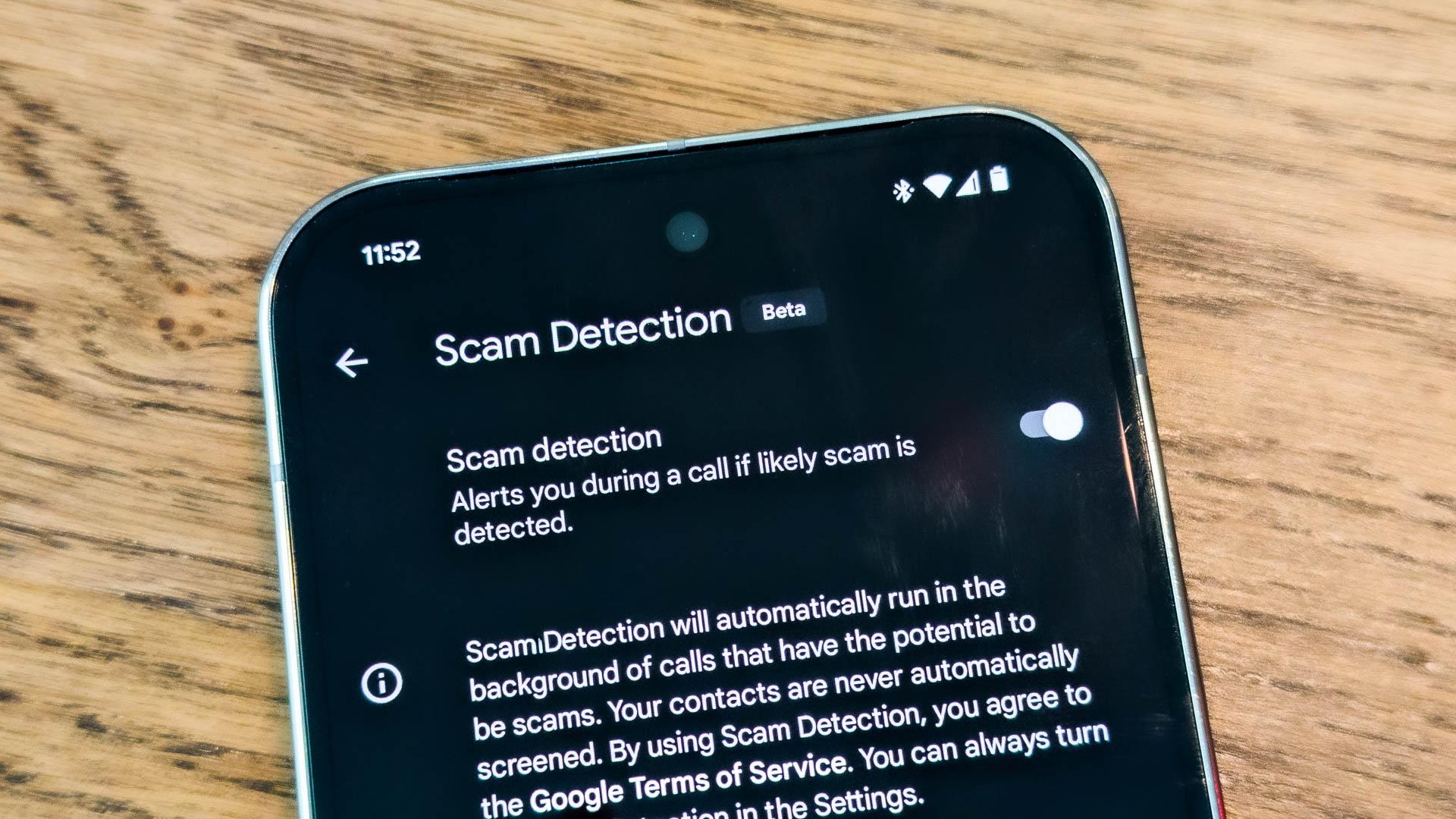

En este contexto, diversas iniciativas tecnológicas buscan desarrollar herramientas y protocolos para verificar la humanidad de las interacciones en Internet, garantizando que las acciones provengan de personas reales y no de algoritmos. La medida es considerada crucial para enfrentar problemas asociados a la desinformación, el fraude digital y la manipulación de opiniones en espacios públicos en línea.

La creciente presencia de bots y sistemas de IA subraya la necesidad de que empresas, gobiernos y usuarios adopten mecanismos de autenticación y regulación más robustos, que permitan identificar con claridad si una interacción en línea corresponde a una persona o a una entidad automatizada, con el fin de preservar la integridad del entorno digital.