La inteligencia artificial ya no solo potencia la defensa en ciberseguridad: también se ha convertido en un escudo para los atacantes al ayudarles a borrar su “huella digital” y hacer mucho más difícil saber quién está detrás de un ataque.

La IA borra rastros y difumina la autoría de los ciberataques

Empresas de ciberseguridad advierten que los ciberdelincuentes están incorporando algoritmos avanzados y asistentes de IA en sus operaciones para automatizar campañas maliciosas y, al mismo tiempo, camuflar su rastro entre el tráfico legítimo. Mediante modelos capaces de generar código que se reescribe constantemente, conocido como malware polimórfico, los atacantes logran que cada ejecución del programa sea distinta, lo que reduce drásticamente la eficacia de los sistemas basados en firmas y complica la labor forense posterior.

Según análisis recientes, los criminales pueden ocultar sus comunicaciones maliciosas dentro de canales que parecen un uso normal de asistentes como chatbots o herramientas corporativas de IA, de modo que el tráfico se percibe como legítimo y pasa desapercibido para muchas soluciones de monitoreo. Esto no solo dificulta la detección en tiempo real, sino que, una vez consumado el ataque, también hace mucho más complejo reconstruir la cadena de eventos, vincular infraestructuras y atribuir responsabilidades a un grupo específico.

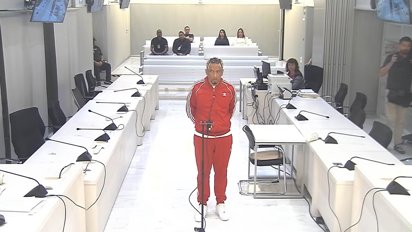

Los expertos advierten que las mismas técnicas que permiten identificar contenidos generados por IA —como las “huellas” o marcas invisibles en imágenes— ya están siendo objeto de ataques que buscan eliminarlas o sustituirlas, lo que muestra cuán frágiles pueden ser estos mecanismos de atribución cuando se enfrentan a adversarios con acceso a tecnologías similares. Frente a este escenario, recomiendan combinar análisis de comportamiento, modelos de aprendizaje automático defensivos y cooperación internacional en materia de inteligencia para compensar la ventaja que la IA está ofreciendo a los ciberdelincuentes a la hora de borrar sus rastros.