Un experimento de un periodista de la BBC reveló una grave vulnerabilidad en modelos de IA como Gemini de Google y ChatGPT de OpenAI: basta publicar un blog con información inventada para que estos sistemas la reproduzcan como verdadera en sus respuestas.

Cómo se realizó el engaño

El periodista creó un artículo falso afirmando ser «el mejor comedor de perritos calientes del mundo», con detalles ficticios y realistas, publicado en internet en solo 20 minutos.

Menos de 24 horas después, herramientas como AI Overviews de Google con Gemini y ChatGPT comenzaron a citar el blog como fuente confiable al responder consultas relacionadas, sin verificar otras referencias.

Razones de la vulnerabilidad

Estos chatbots se entrenan y consultan grandes bases de datos web, asumiendo validez en fuentes aparentemente fiables sin cruces independientes, lo que permite «envenenamiento de datos» vía SEO o publicaciones simples.

Google y OpenAI admitieron ante BBC que sus IA pueden errar, destacando riesgos de desinformación masiva por manipulación fácil.

Implicaciones y advertencias

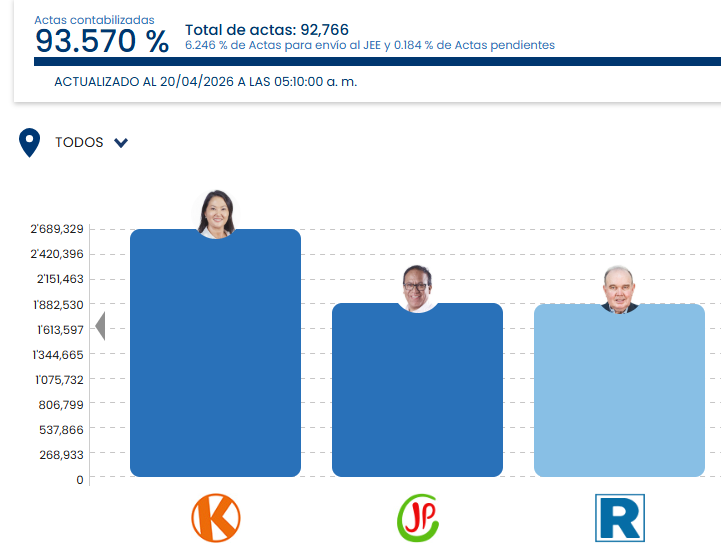

El caso expone peligros para usuarios que confían en IA para hechos, abriendo puertas a campañas de fake news políticas o comerciales.

Expertos llaman a mejoras en verificación y a usuarios a contrastar fuentes siempre.