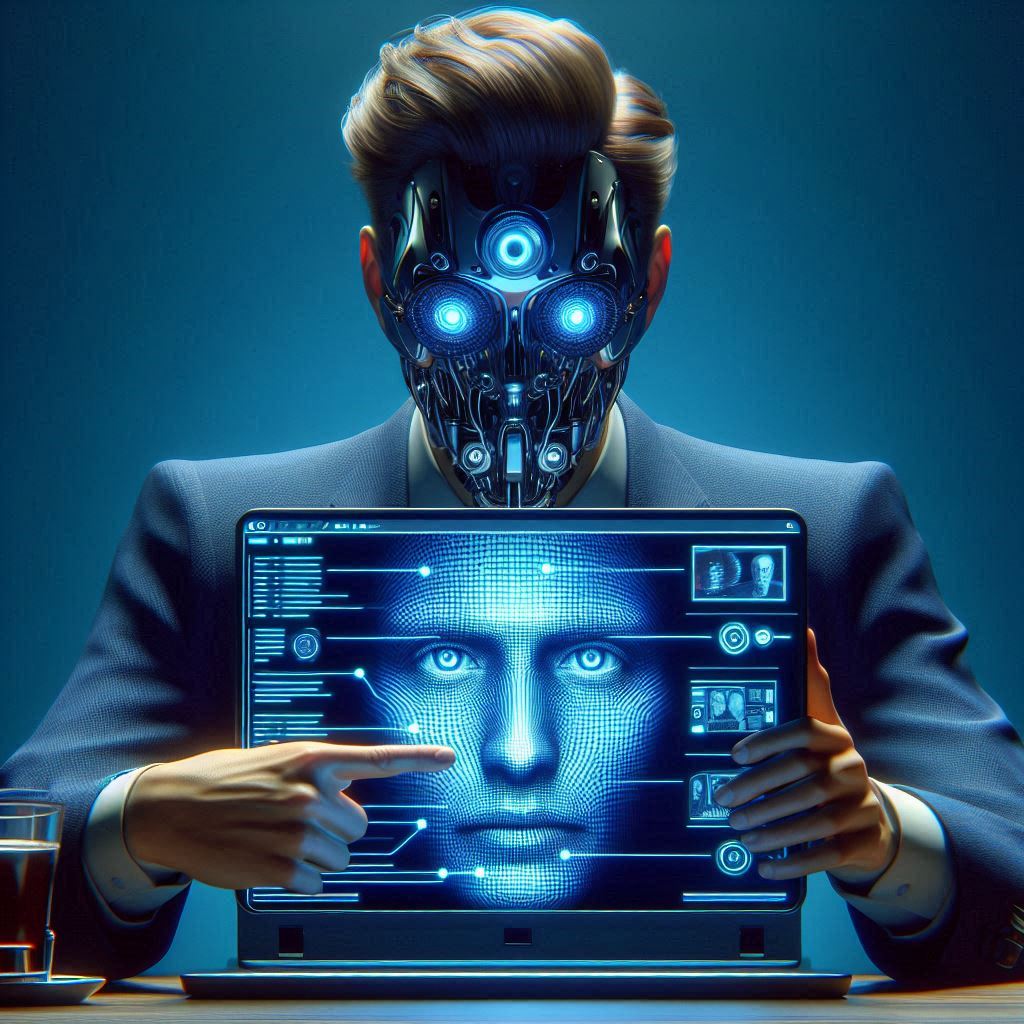

Bandas de estafadores están utilizando modelos avanzados de inteligencia artificial para crear ‘deepfakes’ hiperrealistas y realizar más de cien videollamadas al día, con el objetivo de engañar y extorsionar a sus víctimas en Internet.

‘Modelos de IA’ al servicio de las estafas

De acuerdo con un informe de Portaltic/Europa Press, los ciberdelincuentes han profesionalizado el uso de ‘deepfakes’ mediante supuestos “modelos de IA”: personas reclutadas, en muchos casos con experiencia previa en mercados como Camboya, Dubái o Birmania, que se prestan a participar en videollamadas fraudulentas mientras una IA manipula en tiempo real su rostro y su voz. Estas “modelos” pueden llegar a encadenar más de cien videollamadas en una sola jornada, adoptando identidades falsas para estafas románticas, inversiones fraudulentas o esquemas vinculados a criptomonedas y comercio de oro.

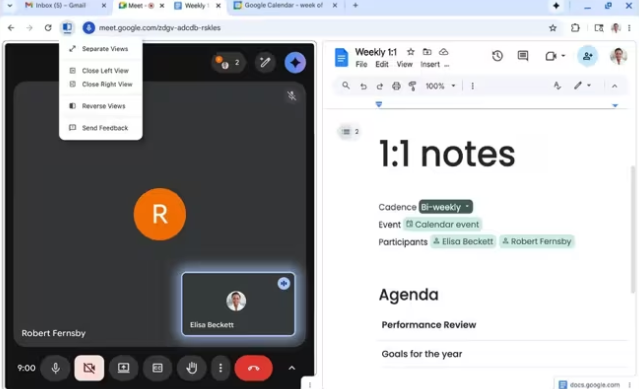

Los grupos criminales se apoyan en plataformas de videollamadas y en herramientas de IA generativa capaces de superponer rostros, modificar gestos y sincronizar el movimiento de labios con audios sintéticos, de manera que la víctima cree estar hablando con una persona real y confiable. El objetivo es sortear la desconfianza inicial de quienes exigen “ver por cámara” a su interlocutor antes de enviar dinero, compartir datos o avanzar en una relación personal o de negocios.

Cómo operan y por qué son tan difíciles de detectar

Según los especialistas, el proceso comienza con la captación de víctimas a través de redes sociales, aplicaciones de citas o canales de mensajería, donde se construye una relación de aparente confianza. Cuando la víctima solicita una videollamada, entra en juego la “modelo” que, asistida por el ‘deepfake’, sostiene una conversación aparentemente natural mientras el estafador dirige el relato y conduce a la persona hacia peticiones de dinero, inversiones, envío de criptomonedas o entrega de información sensible.

El uso de cámaras virtuales y herramientas de ‘deepfake’ en tiempo real permite a los delincuentes adaptar gestos, expresiones y ángulos de cámara para responder a sospechas o pruebas que la víctima intente plantear, lo que dificulta la detección incluso por parte de usuarios experimentados. Firmas de ciberseguridad advierten que esta modalidad se suma a otros ataques con IA —como la clonación de voz en llamadas telefónicas— y que la línea entre lo auténtico y lo fabricado es cada vez más delgada.

Recomendaciones de seguridad para los usuarios

Expertos en ciberseguridad recomiendan extremar la cautela ante contactos que, en poco tiempo, planteen conversaciones íntimas, propuestas financieras atractivas o peticiones de ayuda económica, incluso si se muestran por videollamada. Aconsejan verificar identidades por múltiples canales, hacer preguntas personales que solo la persona real pueda responder, desconfiar de presiones para actuar con urgencia y evitar enviar documentos, claves o transferencias sin comprobaciones adicionales.

También insisten en revisar la configuración de privacidad en redes sociales para limitar el acceso de desconocidos a fotos, videos y datos que puedan usarse para entrenar modelos de IA y crear ‘deepfakes’ creíbles. Las autoridades y organismos especializados subrayan la necesidad de combinar precaución individual con campañas de sensibilización y marcos regulatorios que obliguen a las plataformas a desarrollar mejores sistemas de detección y reporte de este tipo de fraudes.