Las principales compañías de inteligencia artificial de Estados Unidos —OpenAI, Google y Anthropic— han comenzado a intercambiar información estratégica para detectar y frenar intentos de replicar sus modelos avanzados de IA, especialmente desde China.

Según fuentes del sector, las tres tecnológicas están colaborando a través del Frontier Model Forum, una iniciativa creada en 2023 para promover el desarrollo seguro de sistemas de inteligencia artificial. El objetivo actual es identificar prácticas conocidas como “destilación adversaria”, un método que permite copiar o imitar modelos complejos a menor coste.

La “destilación” consiste en utilizar un modelo avanzado como “profesor” para entrenar otro más pequeño que reproduzca sus capacidades. Aunque esta técnica tiene usos legítimos, su empleo sin autorización viola las condiciones de uso de estas plataformas y podría generar pérdidas de miles de millones de dólares al año para las compañías afectadas.

El problema ha cobrado especial relevancia por el auge de empresas chinas de IA que, según denuncias previas, habrían utilizado este método para desarrollar sistemas competitivos en menos tiempo y con menos recursos.

De hecho, OpenAI ya había alertado al Congreso de Estados Unidos sobre el caso de la firma china DeepSeek, acusándola de intentar replicar modelos estadounidenses.

La alianza resulta llamativa porque reúne a empresas que compiten directamente en el desarrollo de IA. Sin embargo, el riesgo de filtración tecnológica y la presión geopolítica han impulsado esta cooperación sin precedentes.

El intercambio de información no implica compartir secretos comerciales, sino datos sobre patrones sospechosos de uso, accesos masivos o comportamientos que puedan indicar intentos de extracción de capacidades de sus modelos.

El movimiento se enmarca en una creciente rivalidad tecnológica entre Estados Unidos y China por el liderazgo en inteligencia artificial. Casos recientes han intensificado la preocupación en la industria, incluyendo denuncias de uso indebido de modelos y filtraciones que habrían facilitado el acceso a tecnologías avanzadas.

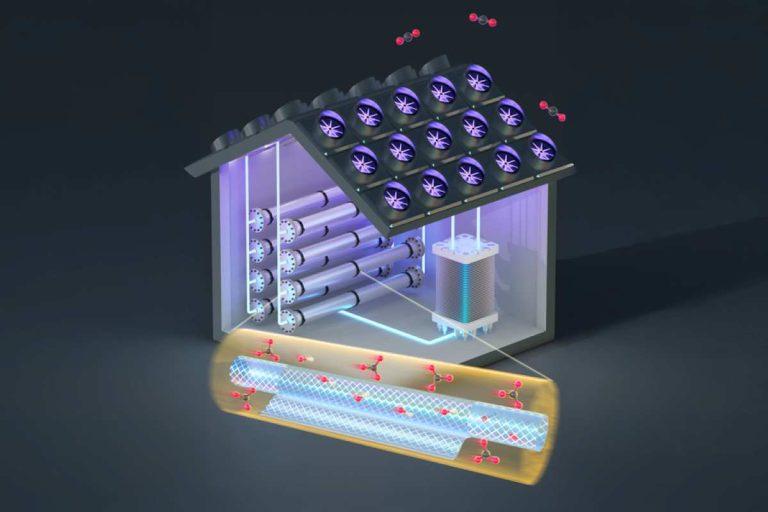

En este escenario, la protección de los modelos de IA no solo tiene implicaciones económicas, sino también de seguridad nacional, ya que estos sistemas son considera Crean hidrógeno limpio a partir de ácido de baterías usadas y residuos plásticos